人工智能研究者佩德罗·多明戈斯在其著作《大师算法》(The Master Algorithm)一书中提出了单一算法的概念,该算法可以结合机器学习的主要流派。

毫无疑问,这个想法非常雄心勃勃,但我们已经看到过很多类似的想法。

Google发表了一篇标题醒目的研究论文,该标题为《一种学习所有的知识的模型》,该论文结合了单一机器学习模式下的异构学习技术。

Alphabet的子公司DeepMind又向多模型算法迈出了一步,它引入了一种称为可微分归纳逻辑编程(ILP)的新技术,此技术将逻辑和神经网络结合到一个模型中,以便从噪声数据中提取规则。

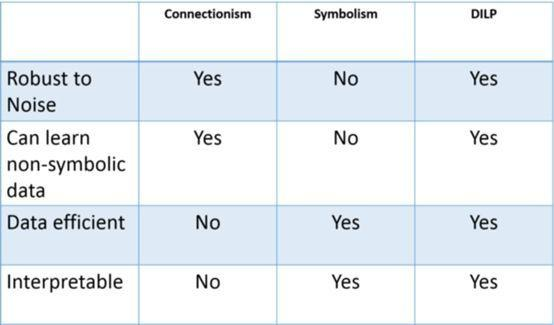

ILP结合了两个主要的机器学习流派。连接主义者试图通过以神经网络的形式模仿大脑的表现来建模知识,此流派一直是深度学习等行为背后的驱动力。象征主义者依靠逻辑根据易于理解的规则来对知识进行建模。两个流派都有众所周知的优点和缺点。

基于归纳逻辑编程(ILP)的符号系统往往能有效地概括知识,并且对过度拟合具有半免疫性。此外,ILP系统往往非常适合于转移学习场景,在这类场景中,经过训练的模型可以在其他模型中被复制和重用。ILP系统的主要局限性在于未能解决深度学习场景中常常出现的噪声或模糊数据。

连接主义系统往往在有噪声数据的环境中工作良好,并且能够有效地处理不确定性和模糊性。然而,训练和改编这类系统往往价格昂贵。而且从连接主义系统中学习到的知识难以理解,这与象征主义模型的清晰性形成了鲜明的对比。多年来,许多专家强调了将稳健的连接主义学习与象征关系学习相结合的理论价值。ILP无疑是朝着正确方向迈出的一步。

从概念上讲,ILP将神经网络与ILP结合起来作为一个模型,此模型既能处理噪声和模糊数据,同时又能很好地进行概括和避免恶化。ILP是一种能够将两者的优点结合起来的技术,它不同于连接主义模型,因为它可以象征性地概括知识,它也不同于传统的象征主义模型,因为它可以直观地概括知识。下面的矩阵可以更好地说明三种思想流派之间的比较关系。

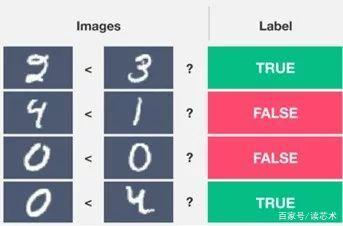

让我们用一个基本的归纳任务来解释ILP的功能,其中一对图像表示数字,并且必须输出一个指示左侧图像的数字是否小于右侧图像的数字的标签(0或1)。解决这个问题涉及两种思维:你需要直观的感知思维来识别图像作为一个特定数字的表示,以及概念思维来完全理解它们的大小关系。

下面列举的任务并不是特别新,可以使用标准的深度学习模型(如卷积神经网络(CNN))来解决。虽然CNN模型完全能够识别数字的新图像,但它很可能无法识别数字本身。换言之,像CNN这样的深度学习策略能够实现视觉概括,而不是符号概括。

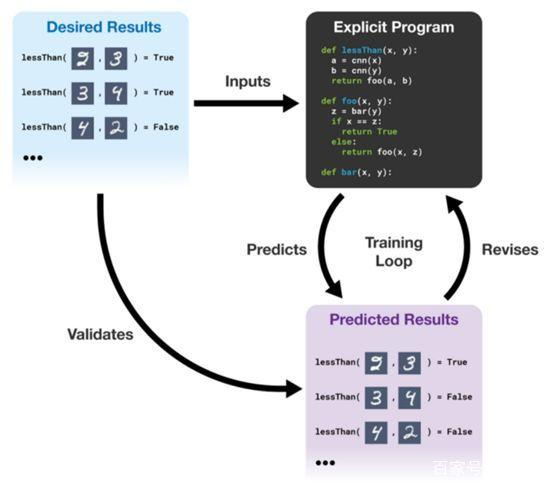

ILP不同于标准的神经网络,因为它能够进行象征性地概括,它也不同于标准的符号程序,因为它能够直观地概括。它从可读、可解释和可验证的示例中学习显式程序。ILP能为给定的一部分示例生成满足这些示例的程序。它使用梯度下降搜索程序空间。如果程序的输出与参考数据的所需输出相冲突,系统将修改程序以更好地匹配数据。

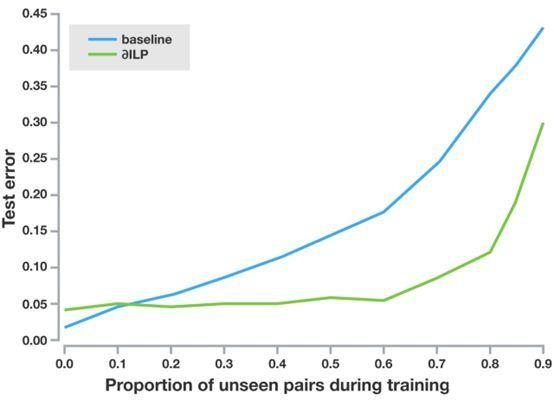

实验的结果表明,ILP能够通过其他逻辑模型和深度学习模型,在象征性、形象化方面都优于既定标准。

ILP是将机器学习中两个主要方法结合在一起的非常有创意的想法。它将连接主义系统的直观知识与象征主义者的概念知识相结合,向模拟人类认知又迈近了一步,并且可能向多明戈的终极算法也迈近了一步。