近日,Science子刊发表文章,来自Facebook、加州伯克利分校和德克萨斯奥斯汀大学的研究人员通过强化学习解决了“如何让智能体获取信息性的视觉观察”的问题。具体来说就是,AI智能体对新环境“瞥上几眼”,就能快速推断整个新环境的情况。AI的能力越来越接近人类了。

又接近了人类一步。

当我们给计算机视觉系统输入一张照片时,它们可以很容易捕获照片中的信息。但是,自主捕获信息对于计算机视觉系统还是非常困难的。

简单来说就是,当我们人类看到下图左、中两个不同方向的奖杯时,就有可能推测出第三个方向上奖杯的样子。

但对于计算机视觉系统或者AI智能体来说,这种能力的实现是较为困难的。

近日,Science子刊(Sience Robotics)封面发表了一篇文章,便对这项任务做了深入研究,并让智能体的视觉系统取得了突破性进展。不得不感叹AI离人类的距离又拉近了一段!

文章链接:

https://robotics.sciencemag.org/content/4/30/eaaw6326

来自Facebook、加州伯克利分校和德克萨斯奥斯汀大学的研究人员通过强化学习解决了“如何让智能体获取信息性的视觉观察”的问题。具体来说就是,AI智能体对新环境“瞥上几眼”,就能快速推断整个新环境的情况。

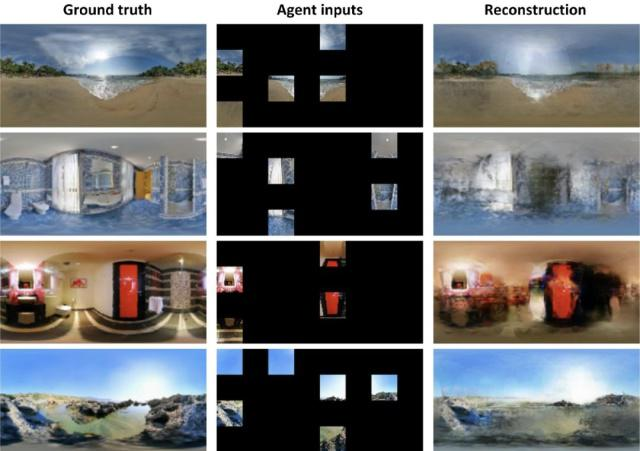

如上图所示,AI智能体快速对新环境不同方向拍摄快照并作为输入,通过总计不超过20%场景内容的照片即可推测整个场景内容!

“轻轻一瞥”,新场景即刻再现!

对于一个智能体,环境的各个视图只提供所有相关信息的一小部分。

例如,一个智能体如果看到前面的电视屏幕,它可能不知道电视是在客厅还是卧室;智能体从侧面观察一个杯子,可能要从上面看才能知道杯子里面是什么。

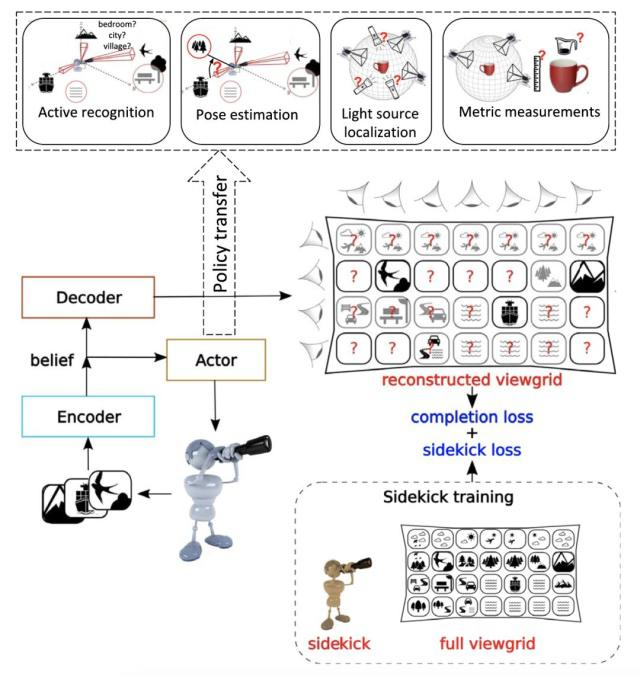

这项研究的目标是学习一种控制智能体的摄像机运动策略,这样它就可以有效地探索新的环境和对象。

为此,研究人员制定了一个基于主动观察完成的无监督学习目标。它的主要思想是支持一系列的摄像机运动,这些运动能使智能体周围看不见的部分更容易预测。其输出是一个查找策略,用于在新环境中收集新图像。

主动完成观测任务面临三大挑战:

首先,为了很好地预测未观察到的视图,智能体必须学会从很少的视图理解3D关系。经典的几何解在这些条件下很难求解;其次,智能行动选择是这项任务的关键。鉴于过去的一系列观察结果,系统必须根据可能提供最多信息的新观点采取行动,即,确定哪些视图最能改进其完整视图网格的模型。强调系统将面对在训练期间从未遇到的对象和场景,但仍然必须智能地选择下一步看起来有价值的地方。

作为这些挑战的核心解决方案,研究人员提出了一种用于主动观测完成的RL方法,如下图所示。

我们的RL方法使用递归神经网络来聚合一系列视图中的信息; 随机神经网络使用聚合状态和当前观察来选择一系列有用的相机运动。 智能体根据其对未观察到的视图的预测而获得奖励。因此,它学会了一种策略来智能地选择动作(摄像机动作),以最大限度地提高预测的质量。

在训练期间,完整的viewgrid是已知的,因此允许智能体“自我监督”其策略学习,这意味着它学习时不需要任何人类提供的标签。

该模型判断了像素空间中viewgrid重构的质量,从而保持通用性:整个场景(或3D对象)的所有像素都包含了所有对任何任务都可能有用的视觉信息。

因此,该方法避免使用任何中间语义表示,而采用寻求对许多任务有用的通用信息的学习策略。也就是说,研究人员所提出的方法很容易适应更专业的环境。例如,如果目标任务只需要语义分割标签,那么预测可以放在对象标签的空间中。

RL方法往往存在勘探阶段成本高和部分状态可观测性差的问题。特别是,一个活跃的视觉智能体必须完全基于第一人称视图中有限的可用信息进行一系列的操作。最有效的视点轨迹隐藏在许多平庸的视点轨迹中,阻碍了智能体在复杂的状态-动作空间中的探索。

为了解决这一挑战,作为这项工作的第二个主要技术贡献,引入了“sidekick策略学习”。

sidekick方法引入了奖励塑造和演示,利用训练期间的完全可观察性来预先计算每个候选快照的信息内容。然后,助手引导智能体访问环境中的信息热点或样本中信息丰富的轨迹,同时考虑到在测试过程中可观察性只是部分的事实。通过这样做,助手们可以加快对实际智能体的训练,提高整体表现。

实验结果

数据集

为了基准和重现性,研究人员在两个广泛使用的数据集上评估了提出的方法。

SUN360 dataset for scenes

SUN360拥有26个不同类别的球形全景。数据集包括6174个训练、1013个验证和1805个测试示例。viewgrid有32×32像素分辨率的2D图像。

ModelNet dataset for objects

对于此数据集,智能体操纵3D对象以完成从所有查看方向看到的对象的视图。viewgrid构成了一个隐式的基于图像的三维形状模型。ModelNet有两个计算机辅助设计(CAD)模型子集:ModelNet-40(40个类别)和ModelNet-10 (ModelNet-40的10个类别子集)。不包括ModelNet-10类,ModelNet-40包含6085个训练、327个验证和1310个测试示例。ModelNet-10包含3991个训练、181个验证和727个测试示例。viewgrid有32×32分辨率的2D图像。

基线

研究人员测试了主动完成方法,使用/不使用sidekick策略学习(分别是lookaround和lookaround+spl)与各种基线进行比较:

one-view是用T = 1训练的方法。该基线没有进行信息聚合或动作选择。rnd-actions与研究人员的方法相同,只是动作选择模块被所有可能动作池中随机选择的动作所取代。large-actions选择最大允许动作。 这测试了远距离观点是否足够丰富。peek-saliency使用一个流行的saliency度量,在每个时间步长移动到可触及的最显著的视图。

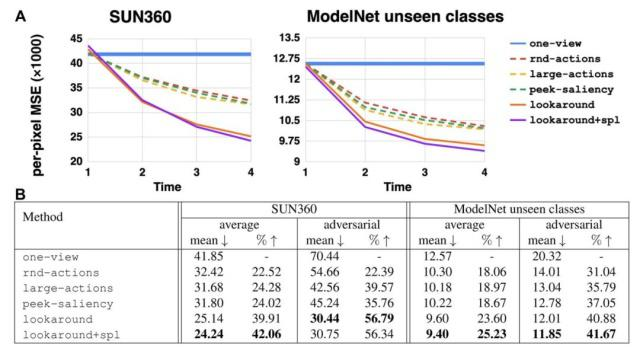

不同智能体行为下的场景和对象完成精度

(A)随着获得更多的一瞥,两个数据集上的像素级MSE错误随时间的变化。(B)所有T次瞥见后,两个数据集的平均/对抗性MSE误差×1000(↓越低越好)和相对于单视图模型(↑越高越好)的相应改进(%)。

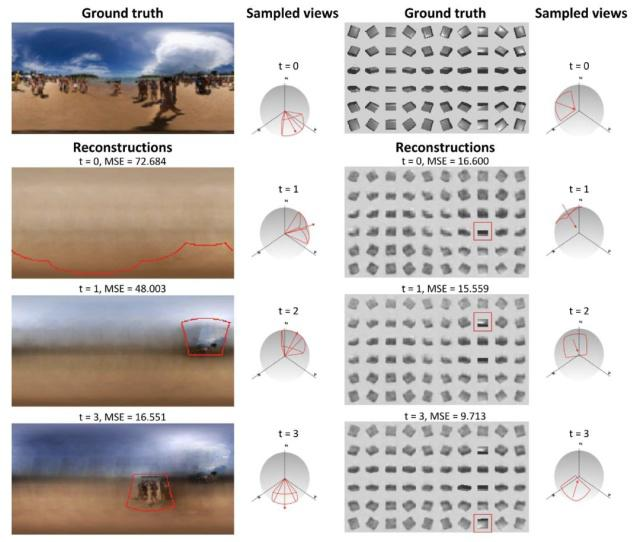

SUN360(左)和ModelNet(右)的活动观测完成情况

对于每个示例,左边的第一行显示了ground-truth viewgrid;左边的后续行显示了t = 0,1,t1 = 3时的重构,以及像素方向的MSE错误(×1000)和代理当前的快照(用红色标记)。在右侧,每个时间步长所采样的智能体观察角度显示在观察球上。重建质量随着时间的推移而提高,因为它可以快速地细化场景结构和对象形状。

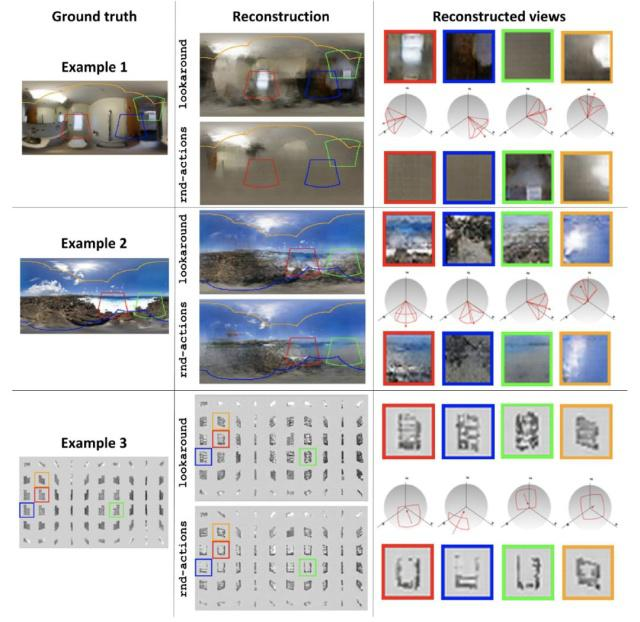

T = 6“瞥见”后的三个重建例子

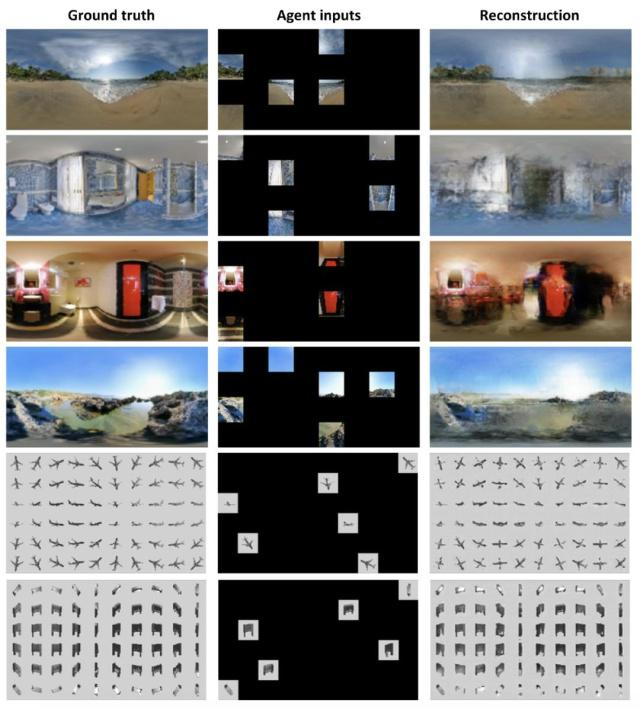

适用于SUN360和ModelNet的多种环境的ground-truth 360全景图或viewgrid以及最终的GAN-refined重建